Dalla Libera Comunicazione alla Censura su Commissione Federale

La Creazione che ha Divorato i Suoi Creatori

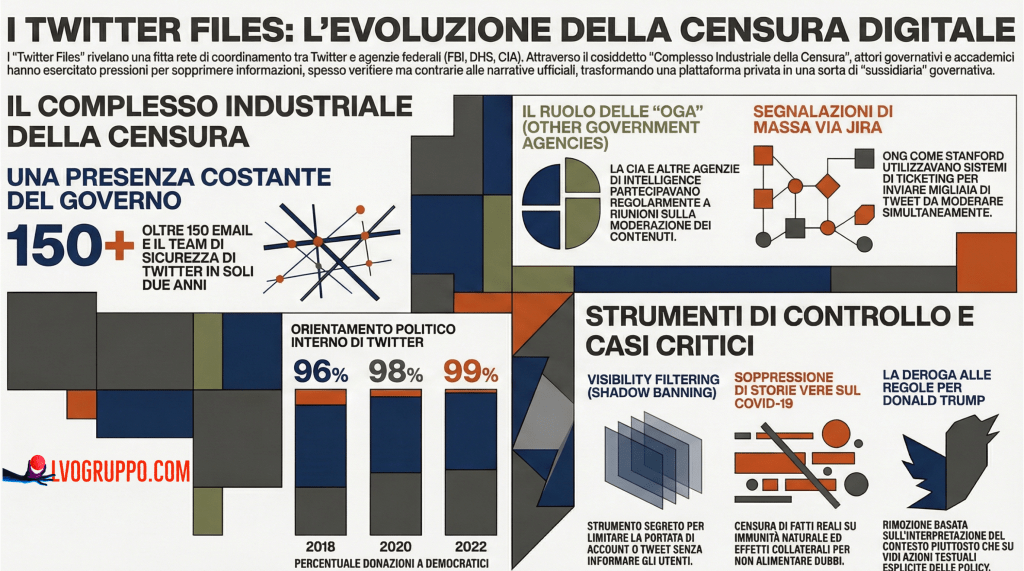

Nel 2006, Jack Dorsey e i suoi collaboratori lanciarono Twitter con una missione audace e apparentemente rivoluzionaria: dare a ogni essere umano il potere di condividere idee e informazioni istantaneamente, senza barriere, abbattendo ogni frontiera nella comunicazione globale. Quella che sarebbe dovuta diventare l’agorà digitale del ventunesimo secolo, lo spazio pubblico dove il dialogo democratizzato avrebbe potuto sfidare i monopoli dell’informazione tradizionale, ha subito nei suoi quindici anni di vita una trasformazione che rasenta l’assurdo distopico. I documenti interni rivelati attraverso i cosiddetti “Twitter Files” non sono semplicemente la cronaca di errori gestionali o di scelte editoriali discutibili: sono la certificazione documentata di una metamorfosi radicale, quella di un organismo nato per la libertà che è diventato un apparato di controllo, sorveglianza e manipolazione del discorso pubblico al servizio dello Stato federale e delle sue agenzie di intelligence.

La metafora utilizzata dagli stessi analisti che hanno esaminato questi documenti è particolarmente efficace e inquietante: Twitter è diventato un racconto Frankensteiniano, un meccanismo costruito dall’uomo ma cresciuto ben oltre il controllo del suo stesso creatore. Questa definizione, apparentemente iperbolica, trova purtroppo riscontro in ogni singolo aspetto delle pratiche documentate. Non si tratta di un cedimento isolato, di una pressione esterna sporadica, di un momento di debolezza aziendale: i Twitter Files rivelano un sistema organico, istituzionalizzato, finanziato e metodicamente implementato nel corso di anni, dove la collaborazione tra una piattaforma privata multimiliardaria e l’apparato di sicurezza nazionale degli Stati Uniti ha raggiunto livelli di integrazione che avrebbero fatto rabbrividire qualsiasi teorico della cospirazione, se solo avessero immaginato la realtà documentata nero su bianco.

Quello che emerge con forza devastante è il fallimento completo e totale delle promesse fondanti di Silicon Valley. La narrazione secondo cui le grandi piattaforme tecnologiche sarebbero state neutrali, meri infrastrutture che trasportano dati senza curarsi del loro contenuto, si sgretola di fronte alla documentazione di una collaborazione sistematica con le agenzie governative, di una moderazione selettiva calibrata su pressioni politiche, di una manipolazione algoritmica che ha determinato quali voci dovessero essere amplificate e quali dovessero scomparire nel silenzio. Il concetto stesso di libero mercato delle idee, pilastro teorico della democrazia liberale, è stato sostituito da una burocrazia opaca dove una manciata di funzionari non eletti, spesso provenienti direttamente dall’apparato di intelligence, decideva cosa milioni di cittadini potessero vedere, credere e discutere.

La domanda che questo scenario pone non è più se Twitter abbia ceduto a pressioni esterne occasionali, ma se la piattaforma non sia stata fin dall’inizio, o quantomeno sin da un certo momento, un progetto di ingegneria sociale al servizio di obiettivi statali. I documenti non offrono una risposta definitiva a questa domanda, ma la rendono legittima e urgente. Quello che è certo, e documentalmente provato, è che quando Elon Musk ha acquisito la piattaforma nell’ottobre del 2022 e ha iniziato a rilasciare这些 documenti interni ai giornalisti indipendenti, ha squarciato il velo su un sistema di censura e manipolazione che opera da anni nell’ombra, con il silenzioso assenso o la activa collaborazione di una classe dirigente tech che ha tradito la fiducia dei suoi utenti e i principi fondanti della rete aperta.

Capitolo Primo: L’Architettura Invisibile della Soppressione

Il Mito Dello Shadow Banning e la Sua Realtà Tecnica

Per anni, i vertici di Twitter hanno costruito una narrativa di negazione sistematica riguardo alla pratica dello shadow banning. Nel 2018, Vijaya Gadde, all’epoca responsabile degli Affari Legali della piattaforma, e Kayvon Beykpour, Capo del Prodotto, emisero dichiarazioni pubbliche perentorie e inequivocabili: Twitter non praticava lo shadow banning, non discriminava mai in base all’ideologia politica, non interveniva mai sulla visibilità dei contenuti se non in caso di violazioni accertate delle policy aziendali. Queste dichiarazioni, ripetute ossessivamente in ogni occasione pubblica, hanno costruito un muro di legittimità attorno alle pratiche della piattaforma, proteggendola da critiche e da possibili indagini regolatorie.

I documenti interni svelano una realtà che rende queste dichiarazioni non merely inaccurate ma deliberatamente false. La pratica esisteva, era sofisticata, sistematica e metodicamente implementata: semplicemente, aveva un nome diverso. Internamente, quella che il pubblico chiamava shadow banning era identificata come Visibility Filtering, un termine tecnico che permetteva di mantenere pubblicamente la facciata della negazione mentre si implementava esattamente ciò che si dichiarava di non fare. Non si trattava di errori algoritmici, di malfunzionamenti occasionali o di interpretazioni eccessivamente rigide delle regole: i documenti rivelano l’esistenza di una vera e propria architettura istituzionale dedicata alla soppressione selettiva della visibilità, con procedure codificate, gerarchie decisionali definite e strumenti tecnici specifici sviluppati per questo scopo.

La definizione che emerge dai documenti interni è particolarmente rivelatrice del livello di consapevolezza raggiunto: “Controlliamo molto la visibilità. E controlliamo molto l’amplificazione dei vostri contenuti. Le persone normali non sanno quanto facciamo.” Questa ammissione, rilasciata da un ingegnere senior della piattaforma nelle comunicazioni interne, rappresenta la confessione involontaria di un sistema pensato per ingannare sistematicamente gli utenti. Il termine “persone normali” non è usato casualmente: designa la stragrande maggioranza degli utenti che non hanno le competenze tecniche per accorgersi delle manipolazioni, che non possono vedere che i loro contenuti vengono declassati, nascosti, soppressi senza che nessuno gliene dia comunicazione. È la descrizione di un sistema di sorveglianza e controllo che opera in modo invisibile su chiunque non abbia gli strumenti per accorgersi di esserne vittima.

La Macchina della Deamplificazione: Strumenti e Tecniche

L’architettura della soppressione non era un monolite indistinto, ma un sistema modulare composto da diversi strumenti, ciascuno progettato per un livello specifico di intervento sulla visibilità degli utenti. Al livello più basic, esistevano strumenti automatici gestiti da algoritmi, che intervenivano in base a parametri predefiniti di comportamento sospetto o di potenziale violazione delle policy. Tuttavia, questi strumenti automatici erano solo la superficie visibile di un sistema molto più profondo e ramificato.

Al di sopra dell moderazione algoritmica standard operava il team SRT-GET, acronimo di Strategic Response Team – Global Escalation Team, una burocrazia di moderazione che gestiva fino a duecento casi ordinari al giorno. Questo team costituiva il livello intermedio di intervento, quello che processava i reclami formali, valutava le violazioni delle policy e decideva le sanzioni ordinarie: sospensioni temporanee, rimozioni di contenuti specifici, avvertimenti formali. Era un sistema pensato per gestire il volume normale di contenuti problematici, costruito secondo procedure standardizzate e tracciate attraverso sistemi di ticketing interni.

Ma per i casi più sensibili, quelli che riguardavano figure politicamente influenti o contenuti che potevano avere implicazioni narrative significative, esisteva un livello superiore e completamente opaco: il SIP-PES, Site Integrity Policy – Policy Escalation Support. Questo gruppo segreto, composto dai vertici aziendali tra cui Vijaya Gadde, Yoel Roth e i CEO Dorsey e Agrawal, prendeva decisioni politiche sensibili al di fuori di ogni normale flusso di ticketing, senza lasciare tracce ufficiali nei sistemi di gestione dei reclami, senza alcun processo trasparente, senza possibilità di appello o revisione. Era qui che venivano gestiti i casi dei Very Important Tweeters, i cosiddetti account VIT, e le eccezioni di interesse pubblico che richiedevano un trattamento speciale.

Le decisioni in questo organismo supremo non erano basate su violazioni oggettive di regole scritte, ma su quello che i documenti definiscono esplicitamente come “sentimento” dei dirigenti, su valutazioni soggettive di potenziale danno reputazionale o narrativo, su calcoli politici mai esplicitati. Un ingegnere interno descriveva il processo come una “Corte Suprema” dove le regole scritte potevano essere sospese in favore di quello che l’establishment aziendale decideva fosse nell’interesse della piattaforma o, più probabilmente, nell’interesse di coloro che esercitavano pressioni su di essa.

Gli Strumenti della Soppressione Selettiva

L’analisi dei documenti rivela l’esistenza di una cassetta degli attrezzi specifica per la deamplificazione selettiva. Il primo e più utilizzato strumento era la Trends Blacklist, una lista che impediva a specifici argomenti o utenti di apparire nella sezione Tendenze della piattaforma. L’effetto di questa blacklist era devastante: impediva la viralità organica di voci dissenzienti che, in condizioni normali, avrebbero potuto raggiungere un pubblico vastissimo semplicemente grazie all’interesse genuino degli utenti. L’inserimento in questa lista era deciso arbitrariamente dal SIP-PES, senza notifica all’interessato e senza possibilità di ricorso.

Un caso esemplare documentato è quello del Dr. Jay Bhattacharya, professore di medicina a Stanford e firma autorevole nel campo dell’epidemiologia. Bhattacharya era colpevole di aver criticato apertamente le politiche di lockdown imposte durante la pandemia di COVID-19, sostenendo, sulla base di dati epidemiologici e considerazioni sul rapporto costi-benefici, che i lockdown avrebbero causato danni significativi alla salute pubblica, in particolare tra le fasce più vulnerabili della popolazione. Per questa opinione scientificamente argomentata, fu inserito nella Trends Blacklist, impedendogli di raggiungere i trending topics anche quando i suoi tweet avrebbero generato un engagement naturale che li avrebbe resi virali. Non era accusato di aver diffuso fake news o disinformazione pericolosa: era semplicemente un opinionista sgradito che andava silenziato.

La Search Blacklist costituiva un altro strumento fondamentale della cassetta degli attrezzi della soppressione. Questa funzionalità isolava specifici account dai risultati di ricerca interni alla piattaforma, rendendoli virtualmente introvabili anche da chi li cercasse consapevolmente. L’effetto era quello di eliminare il punto di accesso diretto tra utente e informazione: anche se qualcuno avesse saputo dell’esistenza di un determinato account, anche se avesse voluto seguirlo attivamente, non avrebbe potuto trovarlo attraverso la funzione di ricerca. Il caso documentato è quello di Dan Bongino, commentatore politico conservatore con milioni di follower, che si ritrovò sistematicamente rimosso dai risultati di ricerca, impedendo a chiunque non lo conoscesse già di trovarlo sulla piattaforma.

Il comando Do Not Amplify rappresentava l’intervento più radicale di deamplificazione. Questa etichetta, applicata a profili specifici, impediva qualsiasi promozione algoritmica automatizzata, rimuovendo l’account dai suggerimenti di follow, dai feed denominati Per Te, da qualsiasi meccanismo di scoperta algoritmica. L’account continuava tecnicamente a esistere, ma era come se fosse stato rinchiuso in una stanza sigillata: solo chi conosceva l’indirizzo esatto poteva trovarlo, e anche in quel caso non avrebbe mai ricevuto notifiche o suggerimenti che lo riguardassero. Charlie Kirk, fondatore di Turning Point USA, fu sottoposto a questo trattamento sistematico.

Il caso più eclatante di manipolazione arbitraria documentata nei file è quello dell’account @libsoftiktok. Questo profilo, che si occupava di documentare quella che definiva come censure e pregiudizi della piattaforma TikTok, divenne oggetto di restrizioni costanti e ripetute sospensioni. I verbali del SIP-PES, esaminati durante le indagini successive, ammettevano esplicitamente che l’utente non aveva violato direttamente la policy sulla condotta d’odio, non aveva diffuso incitamenti all’odio o contenuti chiaramente illegali. Eppure, continuava a essere sospeso e limitato sistematicamente, perché la sua esistenza rappresentava un problema narrativo per la piattaforma. È la certificazione documentata di una censura motivata esclusivamente da ragioni politiche, che operava al di fuori di ogni regola scritta e di ogni principio di proporzionalità.

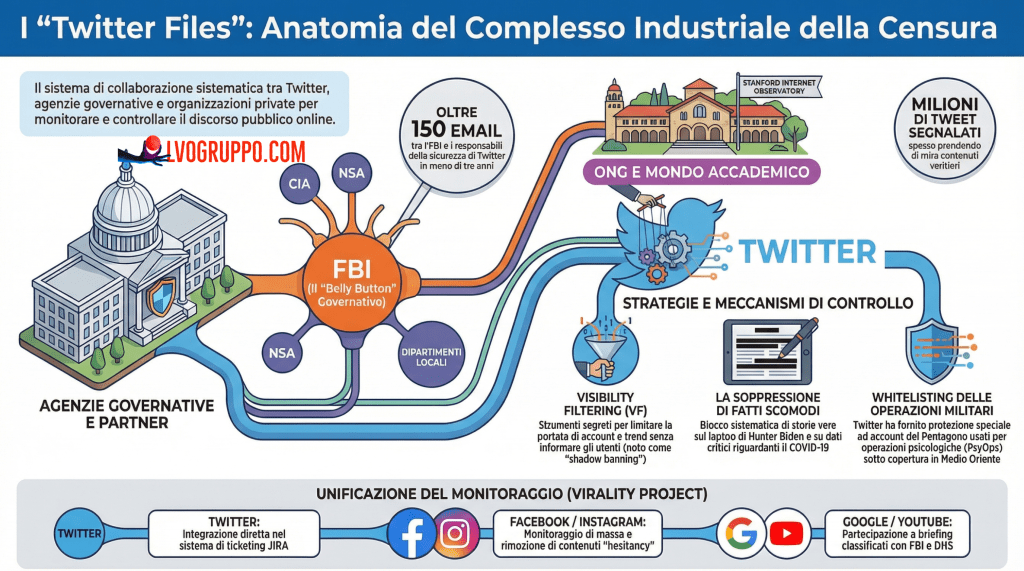

Capitolo Secondo: Il Modello Belly Button

L’FBI come Ombrello dell’Intelligence Community

La collaborazione tra Twitter e le agenzie governative non era episodica, non era il risultato di richieste isolate, non era la risposta a emergenze specifiche: era strutturale, istituzionalizzata e metodicamente organizzata attraverso protocolli formali e canali di comunicazione dedicati. I documenti rivelano l’esistenza di un vero e proprio sistema di coordinamento che trasformava la piattaforma in un terminale operativo dell’apparato di sicurezza nazionale.

L’espressione che meglio descrive questo rapporto è contenuta nei documenti stessi, attribuita all’agente dell’FBI Elvis Chan, in servizio presso la sede di San Francisco. Chan definì l’Ufficio come il “belly button”, l’ombelico, del governo degli Stati Uniti: il punto di contatto unico attraverso cui dovevano confluire tutte le richieste provenienti dall’intera comunità di intelligence. Non si trattava di una metafora retorica, ma della descrizione precisa di un’architettura operativa. L’FBI non agiva semplicemente per proprio conto, ma fungeva da intermediario per la CIA, identificata nei documenti interni con l’eufemismo OGA, Other Government Agency, dalla NSA, dal Dipartimento di Stato attraverso il Global Engagement Center, dal Dipartimento della Sicurezza Interna attraverso la CISA, e da qualsiasi altra agenzia federale che avesse interesse a influenzare il discorso pubblico attraverso la piattaforma.

La definizione di questo ruolo centrale da parte dell’FBI non era casuale: serviva a risolvere un problema logistico e politico. Le piattaforme tech, Twitter in particolare, erano inizialmente riluttanti a collaborare direttamente con entità percepite come troppo politicizzate. Il Global Engagement Center del Dipartimento di Stato, ad esempio, era considerato internamente da Twitter come un organismo troppo chiaramente schierato, troppo partisan per poter fungere da interlocutore credibile. L’FBI, con la sua pretesa di apoliticità istituzionale, rappresentava quindi il canale ideale attraverso cui far passare richieste provenienti da agenzie che altrimenti sarebbero state rifiutate. Era una soluzione elegante al problema di garantire la collaborazione delle piattaforme mantenendo la facciata della neutralità istituzionale.

La consapevolezza interna di questa dinamica era completa e documentata. Stacia Cardille, un’avvocata di Twitter, ammetteva apertamente nei messaggi indirizzati a Jim Baker, all’epoca Deputy General Counsel della piattaforma dopo essere stato General Counsel dell’FBI, che “OGA” fosse un trasparente sinonimo per la CIA. Non c’era alcun tentativo di mantenere la finzione che si trattasse veramente di un’agenza misteriosa non identificata: il segreto era un segreto di Pulcinella, una finzione mantenuta per necessità procedurali ma comprensibile a chiunque avesse competenze minime sul funzionamento dell’intelligence americana.

Il Sistema Teleporter e i Canali di Comunicazione Effimeri

La collaborazione operativa era formalizzata attraverso protocolli tecnici specifici che garantivano l’opacità del flusso informativo. Il sistema denominato Teleporter costituiva il canale primario attraverso cui l’FBI trasmetteva a Twitter elenchi di account da monitorare, documenti di orientamento, richieste di intervento. La caratteristica fondamentale di questo sistema era la sua unidirezionalità: permetteva all’FBI di inviare informazioni a Twitter ma non di ricevere conferme tracciabili di avvenuta ricezione o di azioni intraprese. Molti di questi messaggi erano programmati per svanire automaticamente dopo un periodo predeterminato, garantendo che non rimanesse alcuna traccia della comunicazione nei sistemi di archiviazione.

L’esistenza di canali di comunicazione effimeri, progettati per non lasciare tracce, solleva interrogativi fondamentali sulla natura di questa collaborazione. Un sistema pensato per la trasparenza e la tracciabilità avrebbe previsto registrazioni complete, audit trail, possibilità di verifica. L’esistenza di sistemi pensati per il contrario suggerisce che le parti fossero consapevoli dell’illegalità o quantomeno dell’illegittimità delle operazioni in corso, e avessero costruito infrastrutture specifiche per proteggersi da future responsabilità o indagini.

Le riunioni tra i rappresentanti delle piattaforme tech e quelli dell’intelligence erano organizzate attraverso canali criptati utilizzando l’applicazione Signal, una scelta che, lungi dall’essere una semplice precauzione di sicurezza informatica, suggeriva la consapevolezza che queste comunicazioni non avrebbero dovuto essere tracciate o scoperte. Partecipanti della CIA e della NSA intervenivano in quelle che venivano definite modalità listen only, ascolto, partecipando ai briefing senza prendere la parola, influenzando le decisioni senza lasciare alcuna traccia della loro partecipazione. Era l’architettura perfetta di un sistema di influenza occulta: tutti potevano negare, nessuno poteva essere incolpato, e le decisioni apparivano come autonome della piattaforma quando in realtà erano il prodotto di un coordinamento con agenzie governative mai ufficialmente ammesso.

La Foreign Influence Task Force e la Militarizzazione del Controllo Domestico

La Foreign Influence Task Force, FITF, rappresentava l’unità specifica dell’FBI dedicata al coordinamento con le piattaforme tech. Questa task force contava ottanta agenti, un investimento di risorse che da solo testimonia l’importanza che l’Ufficio attribuiva a questa collaborazione. Nata con ilmandato di contrastare le minacce di influenza straniera, in particolare le operazioni di manipolazione attribuite alla Russia dopo il Rapporto Mueller, la FITF ha progressivamente esteso il proprio raggio d’azione ben oltre le minacce estere, trasformandosi in un organismo dedicato alla sorveglianza e al controllo del discorso pubblico domestico.

I documenti rivelano che la FITF processava regolarmente segnalazioni riguardanti account di cittadini americani, spesso per contenuti che non avevano nulla a che fare con minacce straniere ma che erano semplicemente considerati sgraditi o problematici dalle autorità. Satira politica, critiche al governo, opinioni conservative, discussioni su temi divisivi: tutto poteva finire nel mirino della task force, che inviava a Twitter richieste di intervento su contenuti che non violavano alcuna legge ma che disturbavano l’establishment di Washington. È la certificazione documentata di quello che molti critici avevano a lungo sospettato: le agenzie di intelligence americane avevano rivolto verso l’interno gli strumenti originariamente sviluppati per contrastare minacce terroristiche ed estere, trasformando il paese stesso nel target della propria sorveglianza.

Il Finanziamento della Censura: I 3,4 Milioni di Dollari

Il rapporto di subordinazione tra Twitter e l’apparato federale non era solo ideologico o operativo, ma anche finanziario. Tra il 2019 e il 2021, l’FBI ha versato a Twitter oltre 3,4 milioni di dollari, una somma presentata pubblicamente come rimborso delle spese sostenute per processare le richieste governative. Questa formulazione eufemistica non riesce a mascherare la natura reale del pagamento: Twitter era pagato per censurare. Non con soldi nascosti, non con tangenti sottobanco, ma con trasferimenti ufficiali documentati, trasformati in parte del bilancio aziendale, che compensavano la piattaforma per il tempo dedicato dai suoi dipendenti a soddisfare le richieste dell’intelligence federale.

L’esistenza di questo finanziamento solleva questioni giuridiche fondamentali che non sono mai state adeguatamente affrontate. Il Primo Emendamento della Costituzione americana proibisce al governo di legiferare per restringere la libertà di parola. Il finanziamento di enti privati perché questi censurino al posto dello Stato rappresenta una violazione palese di questo principio: è un espediente per ottenere attraverso intermediari ciò che la legge proibisce direttamente. Quando il governo paga Twitter per censurare, sta di fatto esercitando il potere censorio che gli è costituzionalmente precluso, semplicemente attraverso le mani di un attore privato. Questa pratica, documentata nei Twitter Files, rappresenta una delle più gravi erosioni della libertà di parola nella storia americana, e merita un’indagine giudiziaria approfondita sulle sue implicazioni costituzionali.

La trasformazione di Twitter in un subappaltatore dello Stato, pagato per svolgere funzioni che il governo non può svolgere direttamente, apre scenari inquietanti sulla natura del potere nelle democrazie occidentali. Se il governo non può censurare direttamente ma può pagare aziende private per farlo, il Primo Emendamento diventa una protezione vuota, una garanzia formale svuotata di ogni contenuto sostanziale. È la legalizzazione della censura attraverso l’outsourcing, e i Twitter Files ne forniscono la documentazione completa.

Capitolo Terzo: La Soppressione della Storia del Laptop di Hunter Biden

L’Operazione di Priming e la Trappola Cognitiva

Il 14 ottobre 2020 rappresenta il momento di massima cristallizzazione delle pratiche documentate nei Twitter Files. In quella data, il New York Post pubblicò un’inchiesta giornalistica basata sul contenuto di un laptop appartenuto a Hunter Biden, figlio del candidato presidenziale democratico Joe Biden. L’inchiesta rivelava informazioni potenzialmente devastanti per la campagna elettorale: legami commerciali con aziende ucraine, возможное coinvolgimento del padre in affari familiari, email che suggerivano un utilizzo improprio della posizione istituzionale dell’allora Vice Presidente degli Stati Uniti.

La risposta di Twitter a questa pubblicazione fu immediata, drastica e, secondo i documenti interni, frutto di un condizionamento iniziato mesi prima. L’FBI aveva sistematicamente “istruito” i dirigenti di Twitter, in particolare Yoel Roth, Capo della Sicurezza, affinché si aspettassero un’operazione di hack-and-leak di matrice russa nel periodo pre-elettorale. Questo condizionamento non era basato su intelligence specifica riguardo alla storia del laptop: era una strategia generale di dissuasione, finalizzata a creare un pregiudizio cognitivo che avrebbe portato a interpretare qualsiasi rivelazione simile come una manipolazione straniera, indipendentemente dalla sua veridicità.

Il condizionamento era passato attraverso diversi canali. L’Aspen Institute aveva organizzato esercitazioni tabletop specifiche sulla minaccia di operazioni di hack-and-leak, addestrando i dirigenti tech a rispondere con sospetto e rigidità a qualsiasi rivelazione che presentasse caratteristiche simili. L’FBI aveva menzionato specificamente il gruppo hacker APT28, legato all’intelligence russa, come la minaccia più probabile. Queste informazioni erano state fornite a Twitter non come avvertimenti basati su intelligence specifica, ma come orientamenti generali che creavano un frame interpretativo: qualsiasi notizia simile doveva essere trattata come potenzialmente manipolata.

Quando la storia del laptop emerse realmente, la trappola cognitiva era già scattata. I dirigenti di Twitter, preparati a vedere un’operazione russa, non riuscirono a valutare oggettivamente la situazione: la notizia fu automaticamente inquadrata come disinformazione nemica, indipendentemente dalla sua accuratezza o dal fatto che l’FBI sapesse da quasi un anno che il laptop era reale. È la dimostrazione più eclatante di come l’intelligence possa condizionare il discorso pubblico non attraverso la censura diretta, ma attraverso il precondizionamento di coloro che dovrebbero prendere le decisioni editoriali.

L’Abuso della Hacked Materials Policy

La giustificazione tecnica utilizzata per bloccare la storia fu l’applicazione della Hacked Materials Policy, una regola pensata per impedire la diffusione di contenuti ottenuti attraverso attacchi informatici. Questa policy aveva requisiti specifici e procedure definite: per essere invocata, richiedeva un accertamento ufficiale da parte delle forze dell’ordine che l’hacking fosse effettivamente avvenuto. Nel caso del laptop di Hunter Biden, nessun accertamento del genere esisteva. L’FBI non aveva aperto un’indagine formale sull’hackeraggio perché, semplicemente, non vi era stato alcun hackeraggio: il laptop era stato consegnato volontariamente a un laboratorio di riparazione e il suo contenuto era stato copiato legalmente prima che la polizia ne avesse contezza.

I documenti interni di Twitter rivelano che i team tecnici faticavano a trovare le basi per invocare la policy. Trenton Kennedy, un funzionario della comunicazione, espresse dubbi espliciti sulla legittimità dell’azione: “Non possiamo dire onestamente che questo faccia parte della policy”, scrisse in un messaggio riportato nei verbali interni. Brandon Borrman, altro dirigente, sollevò obiezioni simili, notando che la giustificazione era fragile e che applicarla avrebbe significato violare le proprie regole dichiarate. Nonostante questi dubbi espliciti, la decisione di bloccare la storia fu mantenuta.

La decisione finale fu presa da Jim Baker, che ricopriva il ruolo di Deputy General Counsel di Twitter dopo essere stato per anni il General Counsel dell’FBI. Baker era l’uomo che aveva coordinato le indagini Trump-Russia, che aveva avviato i procedimenti che avevano portato all’insabbiamento delle indagini su Hillary Clinton, che aveva partecipato alle riunioni dove si erano decise le strategie di risposta all’influenza russa. Era l’incarnazione della revolving door tra apparato di intelligence e piattaforme tech: l’uomo che aveva coordinato la sorveglianza dal governo ora la facilitava dall’interno dell’azienda.

Baker gestì la decisione come quella che nei documenti viene definita un’operazione di “freelance”, non coordinata con le procedure standard, non supportata da analisi tecniche adeguate, imposta nonostante le obiezioni dei team competenti. Il suo ruolo fu quello di assicurarsi che la censura proseguisse anche quando le giustificazioni tecniche si erano dimostrate insussistenti, anche quando i suoi stessi colleghi dubitavano della legittimità dell’azione, anche quando il pretesto dell’hacking era ormai evidente a tutti come una frode.

Il Blocco dei Messaggi Diretti e l’Eccesso Censorio

Per impedire la diffusione della storia, Twitter implementò restrizioni senza precedenti nella propria storia. Non solo bloccò la condivisione del link attraverso tweet, ma impedì anche che l’articolo potesse essere condiviso attraverso i Messaggi Diretti, DM, della piattaforma. Questa misura rappresentava un’anomalia grave: l’uso dei DM era tradizionalmente riservato a contenuti estremamente illegali, in particolare pedopornografia e contenuti che violavano la privacy sessuale di minori. Applicare la stessa restrizione a un’inchiesta giornalistica pubblicata da una testata prestigiosa significava riconoscere implicitamente che l’operazione era considerata più grave, più pericolosa, più minacciosa per il sistema di potere esistente della distribuzione di contenuti pedopornografici.

L’entità di queste restrizioni fu documentata nei rapporti interni: l’articolo del New York Post fu sottoposto a un livello di blocco che normalmente sarebbe stato riservato ai contenuti peggiori della piattaforma, quelli che rappresentavano le violazioni più gravi e più evidenti delle policy. Per un articolo che non conteneva materiale illegale, non conteneva incitamenti alla violenza, non conteneva hate speech, questa classificazione rappresentava una falsificazione deliberata della sua natura, motivata esclusivamente da considerazioni politiche.

Le comunicazioni interne rivelano che quasi tutti i dirigenti coinvolti si resero conto nel giro di poche ore che la giustificazione dell’hacking non avrebbe retto. Il pretesto era fragile, non supportato da prove, in contraddizione con le stesse regole che Twitter dichiarava di seguire. Eppure, nessuno ebbe il coraggio di invertire la rotta, di ammettere l’errore, di tornare atrás. Il documento riporta un’ex dipendente che commenta: “Hanno agito da freelance. L’hacking era la scusa, ma nel giro di poche ore quasi tutti hanno capito che non avrebbe retto. Ma nessuno ha avuto il fegato di fare marcia indietro.” È la confessione di una sistema in cui la verità e la correttezza procedurale erano subordinate alla preservazione del proprio status, all’evitamento di decisioni impopolari, all’allineamento con la narrativa dominante.

Le Implicazioni per l’Integrità Elettorale

La soppressione della storia del laptop di Hunter Biden, avvenuta a pochi giorni dalle elezioni presidenziali del 2020, solleva interrogativi devastanti sull’integrità del processo democratico americano. Se una piattaforma con centinaia di milioni di utenti può bloccare la diffusione di un’inchiesta giornalistica sulla base di pretesti falsi, con il coordinamento e l’incoraggiamento dell’intelligence federale, il concetto stesso di elezioni libere perde significato. Gli elettori non possono fare scelte informate se le informazioni rilevanti vengono sistematicamente soppresse.

La circostanza che l’articolo riguardasse il figlio di un candidato presidenziale in carica aggiunge un livello ulteriore di gravità. L’intervento dell’intelligence federale per bloccare una storia potenzialmente dannosa per un candidato specifico solleva questioni di conflitto di interesse e di abuse of power che non sono mai state adeguatamente investigate. L’FBI, che avrebbe dovuto essere un’agenzia neutrale preposta all’applicazione della legge, era invece coinvolta nel proteggere un candidato specifico da rivelazioni giornalistiche scomode, interferendo attivamente nel processo elettorale che avrebbe dovuto limitarsi a supervisionare.

I Twitter Files non provano che il laptop contenesse le prove di attività illegali da parte di Joe Biden. Non provano che la storia fosse interamente accurata. Ciò che provano, inequivocabilmente, è che una storia potenzialmente rilevante per centinaia di milioni di elettori americani fu soppressa, coordinatamente dall’intelligence federale e da una piattaforma privata, non per proteggerli dalla disinformazione ma per proteggerli dalla verità scomoda. È la certificazione documentata di una manipolazione elettorale sistemica, che merita un’indagine approfondita su chi prese queste decisioni e perché.

Capitolo Quarto: Il Complesso Industriale della Censura

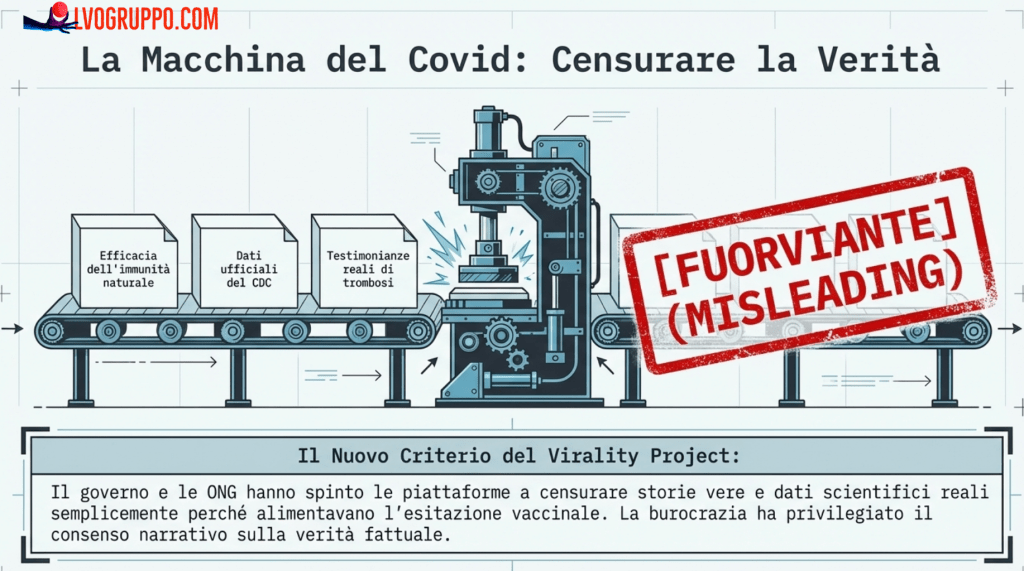

Il Virality Project e l’Onboarding di Stanford

La gestione della pandemia di COVID-19 ha rappresentato il momento di massima espansione del sistema di censura documentato nei Twitter Files. Durante l’emergenza sanitaria, la moderazione è passata da un’attività di contrasto a contenuti specificamente falsi e dannosi a una strategia di controllo sistematico della narrazione complessiva, dove il confine tra verità e menzogna si dissolveva a favore di un unico criterio: la conformità alla linea governativa.

Il meccanismo centrale di questa trasformazione fu il Virality Project, un’iniziativa sviluppata dallo Stanford Internet Observatory in collaborazione con il Center for Security and Emerging Technology e finanziata attraverso una rete di fondazioni legate al Partito Democratico americano. Questo progetto si proponeva di monitorare la diffusione di informazioni sulla pandemia, identificando quelle che avrebbero potuto “alimentare l’esitazione vaccinale” o “minare la fiducia nelle autorità sanitarie”. Il criterio di valutazione non era più la veridicità fattuale, ma l’impatto potenziale sulla narrazione ufficiale.

L’aspetto più inquietante del Virality Project non era la sua missione dichiarata, ma la sua integrazione operativa nelle piattaforme tech. Twitter e altre cinque major tech sono state integrate nel sistema di ticketing JIRA utilizzato dal progetto, permettendo a Stanford di inviare milioni di richieste di revisione direttamente nei sistemi di moderazione delle aziende. Questo significa che un’organizzazione esterna, non eletta, non responsabile davanti a nessuno, aveva accesso diretto ai meccanismi decisionali di piattaforme che influenzavano il discorso pubblico globale. Non si trattava di segnalazioni spontanee o di reclami formali: era un flusso industriale di richieste coordinate attraverso cui un gruppo ristretto di accademici e funzionari governativi poteva determinare quali informazioni dovessero essere soppresse.

I documenti rivelano che il progetto era in grado di gestire fino a 50 milioni di tweet al giorno, processandoli attraverso algoritmi e valutazioni umane per identificare quelli che dovevano essere deamplificati o rimossi. Questa capacità di processamento su scala industriale trasformava la moderazione da attività reattiva, che interveniva su contenuti specificamente segnalati, a operazione proattiva che scandagliava l’intero spazio comunicativo della piattaforma cercando voci dissonanti.

La Trasformazione della Scienza in Conformità

La conseguenza più devastante di questo sistema fu la trasformazione del concetto stesso di verità scientifica. Durante la pandemia, la “scienza” invocata da Twitter e dai suoi partner accademici non era il consenso della comunità scientifica internazionale, né il frutto di dibattiti aperti e peer review. Era la posizione specifica delle autorità sanitarie americane, in particolare del CDC, elevata a dogma inviolabile, la cui messa in discussione veniva automaticamente etichettata come disinformazione pericolosa.

Il Virality Project richiedeva esplicitamente la censura di storie vere sugli effetti collaterali dei vaccini, non perché fossero false, ma perché il loro fatto di essere vere non impediva che potessero scoraggiare la vaccinazione. È la certificazione documentata di un sistema in cui la verità è sacrificabile se risulta scomoda per gli obiettivi di policy: il fatto che qualcosa sia accaduto realmente non basta per permetterne la discussione pubblica, se qualcuno decide che sarebbe meglio che non fosse accaduto.

Le discussioni sull’immunità naturale furono etichettate come “corrosive” per la fiducia pubblica, nonostante fosse scientificamente documentato che le persone guarite dall’infezione sviluppano una risposta immunitaria significativa. Le informazioni sulle infezioni breakthroug, i casi in cui persone completamente vaccinate contraevano comunque il virus, furono inizialmente negate dal Virality Project nonostante le prove scientifiche crescenti della loro esistenza. La “scienza” non era più un processo di scopertaprogressiva attraverso il dibattito aperto, ma un corpo chiuso di dottrina che doveva essere difeso a tutti i costi, anche a costo di sopprimere le prove contrarie.

Il Silenziamento degli Esperti

I casi individuali documentati nei Twitter Files mostrano l’applicazione concreta di questo sistema di silenziamento. Il Dr. Martin Kulldorff, professore di medicina ad Harvard e uno degli epidemiologi più rispettati al mondo, fu inserito in una Trends Blacklist per aver espresso opinioni basate sui dati ufficiali del CDC ma contrarie alla linea politica del momento. Kulldorff aveva firmato la Great Barrington Declaration, un documento scientifico che proponeva una strategia di protezione mirata per i più vulnerabili invece dei lockdown generalizzati, petizione che raccolse le firme di migliaia di scienziati e medici in tutto il mondo. Per questa opinione scientificamente argomentata, fu sistematicamente deamplificato sulla piattaforma.

Il Dr. Jay Bhattacharya, già menzionato in precedenza, subì lo stesso trattamento per le sue critiche ai lockdown basate su considerazioni epidemiologiche e sul bilanciamento costi-benefici. L’accusa non era di diffusione di informazioni false: era semplicemente di essere in disaccordo con le autorità su questioni che erano legittimamente oggetto di dibattito scientifico. In un sistema sano, il confronto tra diverse posizioni epidemiologiche sarebbe dovuto avvenire pubblicamente, con il pubblico libero di valutare gli argomenti. Nel sistema creato da Twitter e dai suoi partner, questo dibattito fu sistematicamente soppresso.

L’account di Alex Berenson, ex giornalista del New York Times, fu sospeso permanentemente dopo mesi di restrizioni crescenti per aver documentato le sue preoccupazioni sui vaccini COVID. Berenson non diffondeva teorie cospirazioniste o informazioni palesemente false: riportava dati, citava studi, osservava eventi avversi. La sua colpa era di essere critico verso una narrazione che doveva rimanere incontestata, e per questo fu silenziato permanentemente.

Le pressioni non venivano solo dall’interno del governo. Scott Gottlieb, membro del consiglio di amministrazione di Pfizer, esercitò pressioni dirette su Twitter per oscurare post che diffondevano quello che lui definiva “discorso problematico” sui vaccini. È la documentazione di un caso in cui un individuo con interessi finanziari diretti in una specifica narrativa sanitaria poteva influenzare la moderazione dei contenuti su una piattaforma usata da centinaia di milioni di persone. Il conflitto di interesse era palese, documentato, eppure le pressioni furono accolte.

I Fallimenti Metodologici della Moderazione COVID

L’analisi dei documenti rivela anche i fallimenti intrinseci del sistema di moderazione durante la pandemia. La gestione di temi epidemiologici complessi come la miocardite post-vaccinale, l’efficacia delle mascherine, i tassi di trasmissione differenziati per fasce d’età fu affidata a contraenti non esperti, localizzati nelle Filippine, che ricevevano semplici alberi decisionali binari per determinare se un contenuto dovesse essere rimosso o deamplificato. Questi strumenti erano progettati per contenuti semplici, spam o harassment: erano completamente inadeguati per giudicare la complessità di questioni mediche che la comunità scientifica stessa stava ancora dibattendo.

Il risultato fu una moderazione piena di errori sistematici. Contenuti accurati venivano rimossi perché includevano parole chiave sospette. Contenuti imprecisi ma allineati alla narrativa dominante venivano mantenuti perché non attivavano gli algoritmi di rilevamento. Moderatori senza competenze mediche prendevano decisioni su questioni che richiedevano anni di formazione specialistica, applicando regole semplicistiche a situazioni che meritavano analisi sfumate. L’arroganza burocratica di pensare di poter automatizzare giudizi che richiedono competenza umana profonda produsse un sistema che sacrificava la verità sull’altare dell’efficienza.

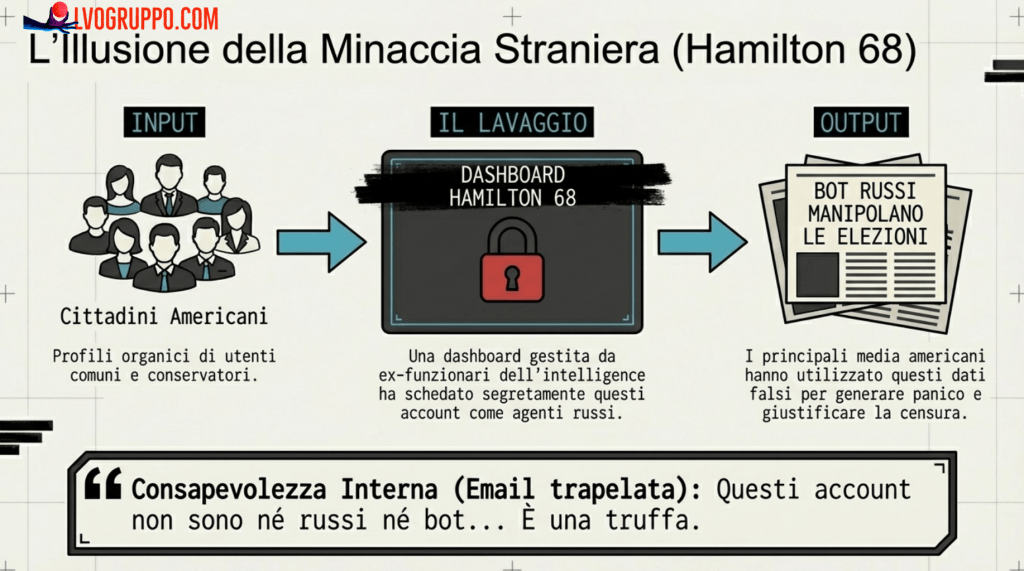

Capitolo Quinto: Hamilton 68 e il Maccartismo Digitale

La Frode della Dashboard Anti-Russa

Per anni, il progetto Hamilton 68 è stato la fonte autorevole citata da media mainstream, politici e commentatori per documentare la presunta influenza russa sul discorso pubblico americano. Questa dashboard, gestita dall’Alliance for Securing Democracy, un think tank finanziato da fondazioni vicine al Partito Democratico e dall governments di paesi baltici, sosteneva di tracciare seicento account identificati come parte di una rete di influenza del Cremlino. Politico, Rolling Stone, MSNBC e decine di altre testate citavano regolarmente Hamilton 68 come fonte per articoli sulle operazioni di disinformazione russa, trasformando i suoi dati in verità accettate senza verifica indipendente.

I Twitter Files hanno svelato che Hamilton 68 era una frode scientifica. Le analisi interne condotte da Twitter rivelarono che la lista non conteneva bot russi né agenti del Cremlino, ma persone reali: cittadini americani, britannici, canadesi che avevano in comune solo il fatto di avere opinioni considerate sgradite dall’establishment. Sonia Monsour, un’immigrata sopravvissuta alla guerra civile libanese che aveva trovato negli Stati Uniti un rifugio dalla violenza, fu etichettata come account legato all’influenza russa per i suoi tweet critici verso la politica estera americana. Dave Shestokas, avvocato costituzionalista che difendeva posizioni conservatrici sui social media, finì nella lista perché le sue opinioni giuridiche divergevano dal consenso di Washington. Joe Lauria, giornalista indipendente che aveva coperto guerre nei Balcani e in Medio Oriente, fu classificato come bot russo nonostante decenni di carriera giornalistica documentata.

L’analisi condotta da Yoel Roth all’interno di Twitter fu particolarmente sarcastica riguardo alla qualità del lavoro di Hamilton 68. Roth commentò internamente, come riportato nei documenti: “Penso che dobbiamo solo chiamare questa cosa con il suo nome: stronzate.” La valutazione tecnica dei team di Twitter era che la lista di Hamilton 68 fosse, nelle parole dei documenti, “bullshit,” sciocchezze, senza alcun fondamento nella realtà. Gli account inclusi non mostravano i comportamenti tipici dei bot automatizzati, non presentavano le caratteristiche tecniche delle operazioni di influenza coordinate, non avevano collegamenti verificabili con entità governative russe.

La Decisione di Non Smentire

Nonostante la consapevolezza interna completa e documentata della frode di Hamilton 68, Twitter non emise mai una smentita pubblica. Il board dell’Alliance for Securing Democracy includeva figure potenti dell’establishment di sicurezza nazionale: ex capi della CIA, ex direttori della NSA, diplomatici di alto rango. Criticarle apertamente avrebbe significato inimicarsi una rete di potere che aveva influenza su regolatori, legislatori e media. La decisione aziendale fu quindi di tacere, di continuare a collaborare con un progetto che sapeva essere una frode, perché i costi di una smentita erano considerati superiori ai benefici della verità.

Questa scelta trasformò Hamilton 68 in uno strumento di persecuzione politica. Per anni, giornalisti e politici citarono la dashboard per etichettare come “agenti russi” cittadini che semplicemente esercitavano il loro diritto di parola su temi controversi. La loro reputazione fu danneggiata, il loro messaggio fu declassato, la loro influenza fu ridotta, tutto sulla base di un documento che le stesse piattaforme che lo implementavano sapevano essere falso. È maccartismo digitale nella sua forma più pura: la lista nera pubblica di dissenzienti, la caccia alle streghe contro coloro che pensavano diversamente, la trasformazione del dissenso in prova di complotto straniero.

Il rapporto tra Hamilton 68 e le agenzie governative merita un’attenzione particolare. Il Global Engagement Center del Dipartimento di Stato finanziava direttamente l’Alliance for Securing Democracy, pompando denaro dei contribuenti americani in un progetto che etichettava cittadini americani come agenti stranieri. È la certificazione che il governo degli Stati Uniti ha finanziato attivamente operazioni di persecuzione politica interna, utilizzando la finzione della minaccia straniera per giustificare il controllo del dissenso domestico. Non c’è differenza sostanziale, in termini di violazione dei diritti civili, tra questa pratica e le attività del Committee on Un-American Activities che perseguitava i comunisti negli anni Cinquanta: cambia il pretesto, ma la sostanza della persecuzione politica rimane identica.

Capitolo Sesto: La Doppia Morale del Pentagono

Gli Account Whitelist del CENTCOM

I Twitter Files hanno rivelato una doppia morale sistemica nelle politiche della piattaforma riguardo alla propaganda. Mentre Twitter chiudeva sistematicamente account accusati di promuovere la propaganda di stati stranieri come Russia, Cina e Venezuela, la piattaforma collaborava attivamente con il Pentagono per proteggere e amplificare le operazioni di influenza militare americana.

Nel 2017, Twitter concesse lo status di whitelist a cinquantadue account del Pentagono. Questo status tecnico rendeva questi profili esenti da segnalazioni per spam o abusi, e li rendeva sistematicamente più propensi a comparire nei trending topics e nei meccanismi di amplificazione algoritmica. Non si trattava di account ufficiali del Dipartimento della Difesa: erano profili creati specificamente per operazioni di influenza psicologica nel Medio Oriente, utilizzando identità fittizie, fotografie di copertura generate da intelligenza artificiale, storie di background fabbricate per creare personaggi credibili di cittadini ordinari che diffondevano messaggi militari americani come se fossero opinioni spontanee.

Molti di questi account operavano quello che nel gergo dell’intelligence viene definito “astro-turfing”: la creazione artificiale di consenso attraverso la simulazione di movimento popolare spontaneo. Sotto le coperture più sofisticate, utilizzavano deepfake e identità composite per mantenere le loro coperture credibili, violando platealmente le policy di Twitter sull’autenticità e sulla disinformazione. Non erano cittadini che parlavano liberamente: erano operazioni di guerra psicologica condotte dal governo americano, protette dalla piattaforma che dichiarava di combattere la propaganda straniera.

La Consapevolezza della Violazione

La questione diventa ancora più grave considerando che Twitter era consapevole di questa violazione. I documenti interni rivelano che la piattaforma aveva rilevato la natura inauthentica di questa rete già nel 2020. Nonostante ciò, ha atteso anni prima di intervenire, proteggendo attivamente la propaganda del Pentagono mentre condannava quella degli avversari geopolitici. I legali di Twitter avevano dato via libera esplicito a queste operazioni, facilitandole invece di fermarle.

È la dimostrazione più chiara che le “policy contro la propaganda” non erano basate su principi, ma su scelte politiche. La propaganda straniera andava rimossa perché gli stranieri erano nemici designati dalla politica estera americana. La propaganda americana andava protetta e amplificata perché serviva obiettivi di policy che Twitter aveva deciso di supportare. Non c’era neutralità, non c’era principio: c’era allineamento con il potere e persecuzione degli avversari, il tutto mascherato da retorica sulla sicurezza nazionale e sull’integrità informativa.

La doppia morale rivelata solleva interrogativi fondamentali sulla natura della libertà di parola nelle democrazie occidentali. Se il governo americano può operare accounts falsi per influenzare il discorso pubblico, protetti da una piattaforma che dichiara di combattere questo tipo di pratiche, il concetto stesso di autenticità della conversazione pubblica perde significato. I cittadini non possono più distinguere tra opinioni genuine di altri cittadini e messaggi fabbricati da operazioni governative nascoste. L’illusione di un dibattito pubblico libero viene mantenuta mentre la realtà è quella di un ambiente completamente gestito da attori statali e privati in collusione.

Capitolo Settimo: La Burocrazia che Decide la Verità

La Trasformazione del Conflitto tra Verità e Narrativa

L’analisi complessiva dei Twitter Files rivela una trasformazione fondamentale nel modo in cui le istituzioni del potere gestiscono il rapporto tra verità e controllo sociale. Storicamente, la propaganda di stato e la manipolazione informativa erano pratiche riconosciute come tali, giustificate esplicitamente in nome della sicurezza nazionale o dell’interesse pubblico. Il ventesimo secolo ha visto l’emergere di una nuova sofisticazione: la negazione stessa del fatto che la manipolazione stesse avvenendo, combinata con la costruzione di apparati che la rendevano sistematicamente possibile.

Il sistema documentato nei Twitter Files rappresenta l’apice di questa evoluzione. Non c’è più bisogno di dichiarare che una determinata verità è pericolosa e deve essere soppressa: la burocrazia della disinformazione definisce autonomamente cosa costituisce “discorso problematico,” “narrazione dannosa,” “contenuto che potrebbe minare la fiducia pubblica.” Questi criteri sono abbastanza vaghi da permettere l’intervento su qualsiasi contenuto sgradito, ma abbastanza formali da permettere la negazione di censorire la verità. È la burocrazia che diventa arbitra della realtà, sostituendo il mercato libero delle idee con una gestione centralizzata del discorso.

Il Ruolo delle ONG e dell’Accademia

Il Censorship-Industrial Complex descritto nei documenti funziona attraverso una rete di attori apparentemente indipendenti ma operativamente integrati. Gli enti accademici come Stanford Internet Observatory e l’Aspen Institute ricevono finanziamenti pubblici attraverso canali come il Dipartimento di Stato, l’USAID, fondazioni legate a interessi politici specifici. Questi fondi permettono loro di condurre ricerche che giustificano l’intervento sul discorso pubblico, creando una legittimazione pseudoscientifica per pratiche che altrimenti sarebbero riconosciute come censura. Gli esperti accademici che firmano questi rapporti non sono imparziali: sono funzionari di un apparato che giustifica la propria esistenza attraverso la produzione di minacce che richiedono il loro intervento.

Le ONG come l’Alliance for Securing Democracy operano nella stessa zona grigia. Finanziati da governi stranieri alleati e da fondazioni politicamente schierate, producono dashboard e rapporti che trasformano opinioni politiche in minacce alla sicurezza nazionale. Il fatto che questi attori non siano formalmente parte del governo permette a quest’ultimo di negare qualsiasi coinvolgimento nella censura, mentre al tempo stesso finanzia e utilizza attivamente il loro lavoro. È la privatizzazione della propaganda e della censura, che permette allo Stato di ottenere attraverso intermediari ciò che gli è costituzionalmente precluso.

L’Erosione del Primo Emendamento

I Twitter Files rappresentano la documentazione più dettagliata di un’erosione sistematica delle libertà civili fondamentali nella più grande democrazia occidentale. Il Primo Emendamento della Costituzione americana, che dovrebbe proteggere la libertà di parola da interferenze governative, viene aggirato attraverso l’outsourcing della censura a attori privati. Quando Twitter censura per conto dell’FBI, quando Stanford produce le liste nere che Twitter implementa, quando le ONG finanziate dai contribuenti definiscono i criteri che le piattaforme devono seguire, il risultato è una censura governativa in tutto e per tutto, semplicemente mascherata da azione privata.

Questa architettura legale permette al governo di fare attraverso le mani di altri ciò che la legge proibisce di fare direttamente. Il Primo Emendamento diventa una protezione formale senza contenuto sostanziale, una dichiarazione di principio che nasconde la realtà di un sistema di controllo dell’informazione perfettamente funzionante. È significativo che nessuno dei dirigenti coinvolti, nessuno dei funzionari dell’intelligence, nessuno degli accademici che hanno costruito questo sistema abbia mai sollevato obiezioni costituzionali: la manipolazione era talmente pervasiva da essere diventata invisibile a chi la praticava.

Conclusioni: Verso una Nuova Comprensione del Potere Digitale

Il Bilancio Complessivo

I Twitter Files non sono la storia di un’azienda tech che ha ceduto a pressioni occasionali, né la cronaca di errori isolati in un contesto emergenziale. Sono la certificazione documentata di una trasformazione sistemica nella natura del potere nelle società democratiche. Per decenni, i teorici della democrazia hanno assunto che il confine tra Stato e società civile, tra potere pubblico e iniziativa privata, fosse una barriera significativa all’abuso di potere. I Twitter Files dimostrano che questo confine può essere aggirato, che attori statali e privati possono collaborare in modo efficace per controllare il discorso pubblico, che la somma delle loro forze è più potente di qualsiasi tentativo di controllo individuale.

Il sistema documentato ha prodotto una società in cui la verità fattuale può essere soppressa se considerata politicamente scomoda, in cui esperti possono essere silenziati per opinioni scientificamente argomentate ma dissonanti, in cui cittadini possono essere etichettati come agenti stranieri per il semplice fatto di pensare diversamente. È la negazione pratica di ogni principio liberale sulla libera formazione del consenso, sostituita da un apparato burocratico che decide in anticipo quali opinioni possano circolare.

Le Domande che Restano Aperte

L’esistenza dei Twitter Files solleva interrogativi che non hanno ancora risposte adeguate. Come è possibile che centinaia di ingegneri, legali, dirigenti abbiano partecipato a questo sistema senza che nessuno denunciasse pubblicamente? Come è possibile che i media, che avrebbero dovuto controllare il potere, abbiano invece amplificato le narrative che questo sistema produceva? Come è possibile che il sistema sia stato smantellato solo con l’acquisizione di Musk, senza che nessuna autorità giudiziaria avviasse indagini sulle pratiche documentate?

Queste domande suggeriscono che il problema non è limitato a Twitter o ai suoi dirigenti, ma è sistemico. L’omogeneità ideologica documentata, con oltre il novantasei percento delle donazioni politiche del personale confluite verso un unico partito, indica una camera d’eco istituzionale dove il dissenso interno era impossibile. La revolving door tra apparato di intelligence e vertici tech creava una classe dirigente con interessi e visioni comuni che non aveva incentivi a criticare pratiche che servivano i suoi obiettivi condivisi. I media mainstream, dipendenti dalle stesse fonti governative che producevano le narrative, non avevano interesse a indagare su un sistema che validava il loro ruolo di gatekeeper dell’informazione.

Verso una Riforma Sistemica

La trasparenza algoritmica non è più un optional democratico ma un requisito minimo per la sopravvivenza di uno spazio pubblico funzionante. Senza la possibilità di verificare come i contenuti vengano amplificati o soppressi, i cittadini non possono fidarsi che la loro conversazione sia genuina. Senza la possibilità di appellarsi contro decisioni algoritmiche, non c’è garanzia che i diritti vengano rispettati. Senza la separazione tra funzioni di intelligence e moderazione dei contenuti domestici, il Primo Emendamento diventa una protezione vuota.

La riforma necessaria non può limitarsi a Twitter: deve affrontare il sistema complessivo che ha reso possibile questo abuso. Il finanziamento pubblico di ONG che producono blacklist di contenuti domestici deve cessare. La revolving door tra intelligence e piattaforme deve essere regolamentata. Le pratiche di moderazione devono essere soggette a trasparenza e a controllo democratico. I confini tra sicurezza nazionale e gestione del discorso pubblico devono essere ristabiliti e difesi.

I Twitter Files sono un monito: dimostrano che le democrazie non sono immuni dall’erosione sistematica delle libertà fondamentali, che il progresso tecnologico può essere utilizzato per controllare invece che liberare, che il potere concentrato, anche quando apparentemente ben intenzionato, tende a produrre abusi. La risposta a questi moniti deve essere non solo riforme specifiche, ma una nuova consapevolezza della necessità di vigilare costantemente sulle istituzioni che dovrebbero servirci, perché il prezzo della libertà è l’eterna opposizione a chi vorrebbe limitarla.

Il futuro della democrazia nel ventunesimo secolo dipenderà dalla nostra capacità di costruire infrastrutture informative che siano veramente al servizio dei cittadini, non dei governi o delle corporations che pretendono di sapere meglio di loro cosa sia vero e cosa sia giusto. I Twitter Files sono la dimostrazione che questa battaglia è già in corso, e che il suo esito non è scontato.

ACQUISTA IN SICUREZZA DAL NOSTRO STORE

Fonti: Twitter Files, documenti interni rilasciati attraverso the-twitter-files.com e pubblicati daMatt Taibbi, Bari Weiss, Michael Shellenberger e altri giornalisti indipendenti.

1. Politiche di Moderazione e Trasparenza di Twitter

Donazioni Politiche: Il riepilogo di OpenSecrets mostra che le donazioni del personale di Twitter sono state quasi interamente a favore dei Democratici

Link: https://www.opensecrets.org/orgs/twitter/summary?id=D000067113

Policy sui Materiali Hackerati: Versione archiviata della politica utilizzata come pretesto per bloccare la storia del laptop di Hunter Biden

Gestione dei Leader Mondiali: Post sul blog di Twitter riguardanti la gestione degli account istituzionali e le eccezioni di “interesse pubblico”

Link: https://blog.twitter.com/en_us/topics/company/2019/worldleaders2019

Eccezioni di Interesse Pubblico: Documentazione del Centro assistenza sulle regole applicate ai funzionari eletti

Link: https://help.twitter.com/en/rules-and-policies/public-interest

2. Inchieste sul Laptop di Hunter Biden e Russiagate

Articolo Originale del New York Post: L’esposizione del 14 ottobre 2020 sulle email di Hunter Biden che Twitter ha cercato di sopprimere

Link: https://nypost.com/2020/10/14/email-reveals-how-hunter-biden-introduced-ukrainian-biz-man-to-dad/

Dichiarazione Giurata di Yoel Roth: Documento depositato presso la FEC in cui l’ex capo della sicurezza spiega di essere stato “preparato” dall’FBI a ignorare la storia del laptop

.

Link: https://www.fec.gov/files/legal/murs/7827/7827_08.pdf

Lettera dei Senatori Grassley e Johnson: Comunicazione all’FBI riguardo ai briefing sull’interferenza russa volti a screditare le indagini su Hunter Biden

.

Link: https://www.grassley.senate.gov/imo/media/doc/grassley_johnson_to_fbi_-_august_2020_briefing.pdf

Indagini su Jim Baker: Articolo di Politico sul coinvolgimento dell’ex avvocato dell’FBI e di Twitter in indagini per fuga di notizie

Link: https://www.politico.com/story/2019/01/15/fbi-general-counsel-criminal-investigation-1101774

3. COVID-19 e Salute Pubblica

Inchiesta di The Free Press: Report completo su come Twitter ha condizionato il dibattito sulla pandemia sopprimendo opinioni divergenti

.

Link: https://www.thefp.com/p/how-twitter-rigged-the-covid-debate

Alex Berenson su Substack: Articoli che documentano le pressioni della Casa Bianca e del membro del consiglio di Pfizer, Scott Gottlieb, per sospendere l’account del giornalista

,

Link: https://alexberenson.substack.com/p/from-the-twitter-files-pfizer-board

Registrazione Stanford (Virality Project): Video di benvenuto del progetto che monitorava i post sui vaccini su diverse piattaforme

4. Elenchi di Account e Operazioni di Influenza (Spreadsheet)

Lista del Senatore Angus King: Elenco di account definiti “sospetti” dall’ufficio del senatore, inclusi utenti comuni

.

Lista “India” del DFRLab: Elenco di 40.000 account sospettati di nazionalismo indù, rivelatisi in gran parte persone reali

Link: https://www.dropbox.com/scl/fi/d31y158qrboceha3feers/India-accounts-full-list-1.xlsx

Liste del GEC (Global Engagement Center): Elenchi di account segnalati per presunta propaganda cinese o russa, spesso contenenti profili occidentali legittimi

Rapporto “Unheard Voice”: Studio di Graphika e Stanford sulle operazioni psicologiche (PsyOp) pro-occidentali supportate segretamente dal Pentagono

5. Piattaforme Giornalistiche e Pubblicazioni dei Twitter Files

Racket News: Portale fondato da Matt Taibbi dove vengono pubblicati approfondimenti sui file

Link: http://racket.news

Matt Taibbi su Substack: Archivio delle inchieste relative al Russiagate e alla “macchina della censura”

Link: https://taibbi.substack.com

The Intercept: Inchiesta sulla collaborazione di Twitter con il Pentagono per le campagne di influenza online

.

Link: https://theintercept.com/2022/12/20/twitter-dod-us-military-accounts/

Rapporto della Commissione Giudiziaria: Documento sulla “strumentalizzazione” del governo riguardo alle pressioni dell’FTC su Twitter

.

Lasciate il vostro commento